إذا عدنا إلى العصور الوسطى الأوروبية سنجد أن السلطة (Authority) دائما ما كانت تُستمدّ من أشياء خارج الإنسان، من الله، من الكتاب المقدّس، من رجال الدّين، فكان المرء إذا سأل سؤالاً من قبيل: ما الخير وما الشر؟ أو ما الجيّد وما السيء؟ يُجاب مباشرة بأن الخير هو ما أوصى به الرب أو الكتاب المقدّس أو آباء الكنيسة أمّا الشر فهو ما نهوا عنه. أي أن الإنسان في ذلك العصر كان يحصل على كل إجابات أسئلته من مصادر خارج ذاته ومشاعره. وإذا تعرّض لمشكلةٍ شخصيةٍ فلا يفكّر في حلّها بنفسه أو يُحكّم عقله فيها بل كان يسأل الله أو رجل الدين. بعبارة أخرى فإن ذلك الإنسان لم يكن يفكّر بعقله الخاص أبداً. أمّا مع "الثورة الإنسانية" (Humanist revolution)، فقد انتقلت السلطة من السماء إلى الأرض، من الله والكتاب المقدس ورجال الدين إلى الإنسان ذاته، فارتفعت الصيحات التي تقول: "يا أيها الإنسان فكّر بنفسك ولا تعتمد على أية سلطة خارجة عن سلطة عقلك أو مشاعرك". لقد نادت الثورة الإنسانية بأن كل الإجابات هي داخل أنفسنا وليست في مكانٍ آخر، فأصبح بذلك الإنسان هو مركز الوجود، أصبح هو مصدر ومعيار كلّ تقويمٍ وقياسٍ. وقد تجلّت هذه "الثورة الإنسانية" في كافة المجالات، في الأخلاق والفن والاقتصاد والسياسة والتعليم وغيرها... فقد أصبح، على سبيل المثال، "الجيد" هو ما يجعل المرء يشعر بشكل جيّد و"السيء" هو ما يجعل المرء يشعر بشكلٍ سيّء، أما "الجميل" فهو ما يراه المرء جميلاً في حين أن "القبيح" هو ما يراه قبيحاً. لقد أصبحت السلطة العليا للإنسان، لكلّ شخصٍ على حدة، للمُشاهد، للمستهلك، للمُنتَخِب، للقارئ...

وقد كان كلّ ما نادت به "الثورة الإنسانية" وألحّت عليه مبني على أساسٍ هو الايمان بحرية الإرادة لدى الإنسان، والايمان القويّ أيضاً بعقل وبمشاعر الإنسان باعتبارهما أفضل ما يمكن أن يعود إليه.

لكن كلّ هذه القصة اليوم، كما يذهب لذلك يوفال نوح هراري، لم تعد ذات معنى. لأن ما كان يُسمّى بحرية الإرادة لم يعد اليوم سوى خرافةٍ من الخرافات التي كانت ترويها الجدّات، وأنّ ما كان يُسمى بالمشاعر ليس سوى "خوارزميات بيوكيميائية" (Biochemical algorithms) وليس هناك أي شيءٍ ميتافيزيقيٍ أو فوق-طبيعي يميّزهم. أما العقل فهو الآخر لم يعد سوى مجرّد برنامج يوضع داخل حاسوبٍ اسمه المــخ، أي أنّ العقل هو عبارة عن برمجةٍ حاسوبيةٍ مزروعة في المخ، وما الحالات العقلية سوى حالات حسابية. وإذا كان الأمر هكذا فإنه يمكن، كما يخبرنا العلماء والمهندسين، أن يتمّ صنع خوارزميات تستطيع أن تقوم بنفس دور المشاعر بل وأفضل منهم، أي أن تستطيع هذه الخوارزميات أن تفهم المرء أكثر مما يفهم هو نفسه. كما ظهرت إمكانية خلق حاسوب مرفق ببرمجةٍ لا تجعله يحاكي العقل فقط، بل تكسبه عقلاً أيضاً. هذا يعني أنّ البشر، بل وكل الكائنات الحية الأخرى، ليسوا سوى خوارزميات (Organisms are algorithms)، وهذا هو ما نجده سائداً في مجال علم الكمبيوتر مثلا (Computer science). هذا يعني، على سبيل المثال، أن مشاعر البشر ليست سوى حسابٍ للاحتمالات لاتخاذ قرارات معينّة. وقد تطّور هذا الحساب عبر ملايين السنين من الانتخاب الطبيعي (Natural selection) لجعل البشر وباقي الحيوانات يتّخذون قراراتٍ صائبة، عندما يتعرّضون لمشاكل معينة، تمكّنهم من البقاء. أمّا الذي يقوم بعمليّة الحساب هذه فهو الجسد في حين تظهر الإجابة على شكل شعور أو إحساس، سواء بالخوف أو بالشجاعة، بالحاجة إلى الهروب أو بالحاجة إلى الإقدام، إلى غير ذلك. هكذا تكون تلك النصيحة القائلة "اتبع مشاعرك" أو "اتبع قلبك" صحيحةً، باعتبار المشاعر هي أفضل مصدر للقرارات من خلال تطورها عبر ملايين السنين من الانتخاب الطبيعي، رغم أنّ أساسها الذي كان مبينا على حرية الإرادة كان خاطئا حسب ما يذهب إليه نوح هراري. كما أن نفس هذه النصيحة لم تعد اليوم صحيحةً دائما، بحجّة أنّه يمكن صنع خوارزميات تساعد الإنسان على اتخاذ القرارات أفضل مما تخبره به مشاعره، التي ليست في نهاية المطاف سوى خوارزميات أخرى.

في ظل هذا الوضع فإنه أصبح بالإمكان القول: "يا أيها الإنسان إذا وقعت في حيرةٍ ما أو في مشكلة ما فلا تتّبع مشاعرك بل اتبع ما تُمليه عليك الخوارزميات". أي أنّ السلطة أو المشروعية قد أُخذت من الإنسان ومُنحت لأشياء خارجة عنه، يمكن أن نسمّيها "آلهةً جديدةً". لقد تمّ صنع "ذكاءٍ اصطناعي" قادر على فهم البشر أفضل من البشر أنفسهم، وها هو يقول لهم: ’’ يا أيها الناس لا تُنصتوا لمشاعركم، بل أنصتوا إلينا نحن، أنصتوا إلى فيسبوك وغوغل وأمازون فهم يعرفونكم أفضل مما تعرفون أنفسكم. إنهم يعرفون ما تشعرون به، بل وأكثر من ذلك، فإنهم يعرفون علّة هذا الشعور. وبالتالي فيمكنهم أن يتخذوا لكم قرارات أفضل مما يمكن أن تتخذوه بأنفسكم"! ويؤكّد نوح هراري أنّ كلّ ما تحتاجه هذه الخوارزميات للقيام بمهمتها على أفضل حالٍ ممكن هو توفرها على ثلاثة أمور: المعرفة البيولوجية (Biological knowledge) الدقيقة بالإنسان (ويمكن جلبها من علوم الدماغ والبيولوجيا)، القوة الحسابية (Computing power) والبيانات الكافية (Data). هكذا يمكننا "اختراق البشر" (hack human) بتعبير نوح هراري، والذي يعبّر عن فكرته هذه بالصيغة الرياضية التالية:

B * C * D = H

لا يعني "اختراق البشر" سوى القدرة على خلق خوارزميات (Algorithms) قادرة على فهم الإنسان أفضل مما يفهم هو نفسه. وعملية الفهم هذه تتضمن أن هذه الخوارزميات يمكنها أن تُعدّل أو تُطوّر ما تراه واجباً عليه ذلك في جسد الإنسان. وفي إحدى محادثات نوح هراري مع فيـي-فيـي لي (Fei-Fei Li) في لقاءٍ نُظّم بجامعة ستانفورد، سألته في هذا الصدد: هل الحبّ قابلٌ للاختراق؟! فأجابها أنه إذا قبلنا أن الحب ليس في نهاية التحليل سوى عملية بيولوجية يقوم بها الدماغ، وأنه إذا استطاع الذكاء الاصطناعي تزويدنا بنظام صحيّ جيدّ من خلال قدرته على التنبّؤ بالأمراض، كالسرطان مثلا، فلا فرق حينها بين السرطان والحب. وتجدر الإشارة إلى أنّ عملية الاختراق هذه لا تعني أننا نريد من الذكاء الاصطناعي أن يفهم الإنسان بشكلٍ يتصف بالكمال، بل نريد منه فقط أن يفهم الإنسان أكثر مما يفهم هو نفسه، وهذا ليس صعبا لأنّ أغلب الناس لا يعرفون أنفسهم جيداً، لا يعرفون ماذا يريدون وماذا يختارون وإلى أين يذهبون... إنّهم في متاهة من أمرهم، والذكاء الاصطناعي يمكن أن يتدخّل ليساعدهم. وهذا ما يقصده نوح هراري عندما نجده يقول إن اختراق البشر هو لصالح البشر.

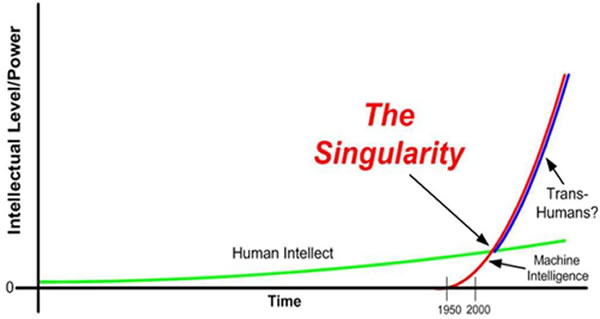

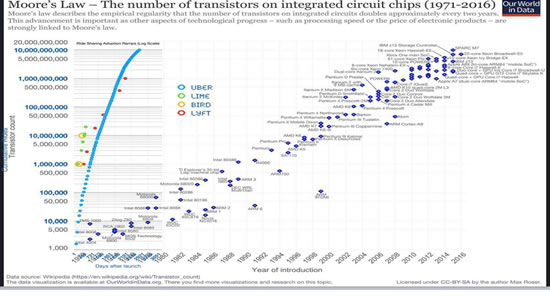

في ظلّ هذا الوضع الذي وصل إليه العلم ظهر ما يسمى بـ "التفرّد التكنولوجي" (Technological Singularity). ويعود استعمال كلمة "Singularity" (التفرّد) إلى حقل الرياضيات حيث إنّ نقطة التفرّد هي النقطة التي يكون عندها التابع الرياضي غير معرّف، أي بدون

قيمة، وبالتالي يفشل في إيجاد سلوكٍ عند هذه النقطة. وعلى سبيل المثال، فإن نقطة التفرد في الدالة f(x) = 1/x هي النقطة 0.

أما "التفرّد التكنولوجي" فيحيل على تلك اللحظة المستقبلية التي سيتفرّد فيها الذكاء الاصطناعي بنفسه بعد أن يخرج عن سيطرة الإنسان. وبالتالي لن يكون للبشر أي قدرةٍ على التحكم بمجرى الأحداث، بل الأخطر أنّهم قد يُصبحون مجرّد عبيدٍ للآلات الذكية! ونجد هذا السيناريو في كثير من أفلام الخيال العلمي، إلا أن هناك من نظّر إلى هذه الفكرة مُعتقداً أنّ هذا الأمر ليس حكرا على أفلام الخيال العلمي وحدها بل إنه لا بد أن يتحقق على أرض الواقع في السنوات المقبلة.

يعود استعمال مصطلح "التفرّد التكنولوجي" إلى فيرنر فينجه (Vernor Vinge)، وهو كاتب خيال علمي أمريكي درّس الرياضيات وعلم الحاسوب بجامعة سان دييغو (SDSU)، وذلك في مقاله الشهير الذي نشره سنة 1993: "التفرّد التكنولوجي القادم: كيف يمكن الاستمرار في الحياة في عصر ما بعد البشرية" (The Coming Technological Singularity: How to Survive in the Post-Human Era)، حيث اعتقد، في ظل التقدّم المتسارع للتكنولوجيا في القرن العشرين، بأن البشرية تسير نحو عصرٍ لن تستطيع فيه التحكّم في التكنولوجيا. وهذا ما سمّاه بــ "التفرّد التكنولوجي". ويحدّد في مقاله هذا أربع وسائل يمكن للعلم أن يصل من خلالها إلى هذا المنعطف الخطير في تاريخ البشرية وهي: أولاً، يمكن للعلماء أن يصنعوا روبوتات تتفوّق على الإنسان باستخدام الذكاء الاصطناعي. ثانياً، إمكانية أن تصبح شبكات الحاسوب ذات ذكاء فوق-إنساني (Superhumanly intelligent). ثالثاً، يمكن أن تصبح التقاطعات بين الإنسان والكمبيوتر أكثر حميمية، وبالتالي قد تؤدي إلى الدمج بينهما وإنتاج ذكاء يتجاوز الذكاء الإنساني. ورابعاً، يمكن لعلم البيولوجيا أن يجد وسيلةً لتصميم الذكاء البشري فعلياً. لكن متى سيتم الوصول إلى هذا "التفرّد"؟ هنا نجد اختلافا بين دعاته، حيث هناك من قال إنه سيكون في مطلع القرن الواحد والعشرين، وهناك من حدّد سنة 2023، وهي حالة فيرنر فينجه، وهناك من حدّد سنة 2045 مثل راي كورزفل (Ray Kurzweil) ...

ليس فيرنر فينجه هو الوحيد الذي يعتقد بهذا السيناريو بل الكثيرون، من بينهم إلون ماسك (Elon Musk) الذي يرى مستقبل البشرية بشكلٍ مرعب ومخيف، حيث يعتقد بقوة وما يفتأ يردّد ويؤكّد على أن الذكاء الاصطناعي هو أكبر خطر يهدّد الحضارة الإنسانية، وأنه لا محالة سوف يخرج عن سيطرة البشر، بل وسيسيطر عليهم وبالتالي على العالم، وسيقود النوع الإنساني إلى أن يصبح عبداً له. وفي طرحه هذا نجده يستشهد بالعالم الفيزيائي الذي غادرنا قبل سنوات قليلة وهو ستيفن هوكينغ (Stephen Hawking) الذي اتفق مع إلون ماسك وحذر من تطور الذكاء الاصطناعي في المستقبل، وذلك في الحوار الذي أجري معه في آخر حياته. كما نجد أيضا المؤرّخ الشهير يوفال نوح هراري الذي يعتقد، وإن بشكلٍ مختلف نوعا ما وغير متشائم، أن النوع الإنساني سيفنى وينتهي وسيحلّ محله نوعٌ جديد، هو مزيجٌ بين الآلة والإنسان، بين الذكاء الاصطناعي والذكاء الإنساني، وذلك من خلال زرع شرائح في جسد الإنسان ستجعله لا يموت أبداً، أي يصبح مثل الإله! وهذا بالضبط هو التصوّر الذي عرضه في كتابه الشهير "الإنسان الإلـه: تاريخ موجز للغد" (Homo Deus: A Brief History of Tomorrow). كما نجد هذا التصور الذي يمنح الخلود للإنسان مُعبّراً عنه بطريقة أخرى، وهي ما تسمّى بــ "تحميل العقل" (Mind Uploading)، والتي تعني أن الإنسان حتى عندما يموت، يفقد جسده، فإنه سيستمرّ في العيش من خلال "تحميل عقله" ووضعه داخل روبوت معين، فيكون بالتالي خالداً رغم أنه لن يكون هناك أي جسد بل "العقل فقط". في هذا الصدد نستحضر ما كُتب على غلاف المجلة الأمريكية "Time" في فبراير من سنة 2011: ’’ 2045: السنة التي سيصبح فيها الإنسان خالداً‘‘.

وغير هذه الأسماء التي ذكرنا هناك الكثير، مثل بيل جيتس (Bill Gates)، في مرحلة معينة، وبيل جوي (Bill Joy) وراي كورزفل (Ray Kurzweil) ...

أما عن الأساس الذي يقوم عليه هذا "التفرد" كما صاغه فيرنر فينجه فهو قانون مـور (Moore’s law) الذي صاغه غوردن مور (Gordon Earle Moore)، أحد مؤسّسي إنتل (Intel)، سنة 1965، والذي يقول إن قدرة وسرعة الآلات الحسابية تتضاعف كل ثماني عشرة شهر بعدما لاحظ أن عدد الترانزستورات (Transistors) يتضاعف في هذه المدة. ويترافق مع هذا التضاعف انخفاض تكلفة أجهزة الكمبيوتر.

بيد أن اعتبار الذكاء الاصطناعي كأكبر خطر يهدّد الحضارة الإنسانية كما قال إلون ماسك، قد صدم العديد من المشتغلين والمختصين في الذكاء الاصطناعي. ففي القسم الثاني من كتابه "الذكاء الاصطناعي غير موجود" ((L’intelligence artificielle n’existe pas، الذي صدر سنة 2019، يعود بنا الباحث والمهندس لوك جوليا (Luc Julia) إلى إلقاء الضوء على سوء الفهم الذي حصل بصدد الذكاء الاصطناعي، حيث أصبح الحديث بعيدا عن الواقع العلمي الرياضي، وبالتالي فالذكاء الاصطناعي كما يتحدث عنه مثل هؤلاء هو في الحقيقة لا وجود له في الواقع. فحسب ما يذهب إليه جوليا، الذي عمل على محاربة هذه التصورات، فإن ما قاله إلون ماسك وستيفن هوكينغ مثلا لا أساس له من الصحّة، وأنه مجرّد إلقاء للكلام على عواهنه اعتمادا على أفكار مستلهمة من أفلام الخيال العلمي وليس من الوقائع الدقيقة المعتمدة على علم الرياضيات، أي أن ما يقوله إلون ماسك هو مناقض تماماً لما نجده عند علماء الذكاء الاصطناعي. ذلك لأنه مبني على فرضيةٍ خاطئة. فالواقع هو أن الروبوتات، على سبيل المثال، لا يمكنها أبداً أن تقوم بأي عملٍ انطلاقا من ذاتها، فهي لا تملك أية أفكار خاصة بها، إنها لا تقوم سوى بما يتمّ أمرُه بها أو ما يتمّ برمجته عليها، وفقط. ورغم أنّه بالإمكان تعليم الروبوتات أفعال سيئة وعنيفة ومدمرة فإن ذلك لا يفيد بأي معنى أن نعتبرهم مالكين لإرادة أو قدرة قد تمكّنهم من الانقلاب على البشر. كما أن خطأ تلك الفرضية يبدو واضحا عندما نضع في حسباننا أنه، منذ فجر التاريخ، لم تكن إرادة السيطرة والهيمنة مرتبطة بالذكاء بل بهرمون التستوستيرون (Testosterone)، أي أنها تصرّف "حيواني" مزروع في جينات الإنسان، وذلك من أجل أن يستطيع الاستمرار في البقاء. كما أنّ ذلك الخطاب الذي يبالغ في وصف الذكاء الاصطناعي وفي الاحتفاء به وتشبيهه بالسحر هو، حسب لوك جوليا، مبالغٌ فيه وينتج عن عدم فهم كيفية اشتغال الذكاء الاصطناعي، وعن سطحية وسذاجة في التفكير. فعلى سبيل المثال نجد البعض يتعجّب ويندهش كثيرا عندما يسمع أنّ بطل العالم في الشطرنج غاري كاسباروف (Garry kasparov) قد هُزم من طرف برنامج لعب اصطناعي (أو Deep Blue) سنة 1997، في حين أن فهم القواعد والأسس الرياضية التي يقوم عليها البرنامج لن تؤدّي بالمرء إلى التعجّب والاندهاش أبداً.

لم يكن لوك جوليا هو الوحيد الذي تصدّى لتلك الأفكار التي راجت حول الذكاء الاصطناعي، إذ نجد الفيلسوف وعالم الحاسوب الفرنسي جون غابرييل غاناسيا (ـJean-Gabriel Ganascia) قد اعتبر أن "التفرّد" ليس سوى مجرّد أسطورة، وذلك في كتابه الشهير "أسطورة التفرّد" (Le mythe de la Singularité) الذي صدر سنة 2017. والذي لم يكن الداعي من تأليفه سوى انتشار مثل تلك الآراء التي قال بها فينجه وإلون ماسك وستيفن هوكينغ وغيرهم. ويخبرنا غاناسيا إن "التفرّد" قائم في حقيقة الأمر، إلى جانب قانون مور، على تمييزٍ بين أمرين هما: الذكاء الاصطناعي الضعيف والذكاء الاصطناعي القوي (IA faible et IA forte)، فالأوّل يقول إنّه بالإمكان بناء أنظمة قادرة على أن تستدّل وتحلّ المشكلات بطريقةٍ تبدو ظاهريا وكأنها ذكية، دون أن تكون كذلك في الحقيقة. أمّا الثاني فيقول إنّه بالإمكان خلق ذكاء اصطناعي يمكن أن يفكّر ويستدلّ ويتوفّر على نوعٍ من الوعي بالذات كما هو الحال بالنسبة للإنسان. وتجدر الإشارة إلى أنّ هذا التمييز، كما يشير إلى ذلك غاناسيا، لم يقل به متخصّص ما في الذكاء الاصطناعي أو عالم حاسوب بل من قال به هو فيلسوف، وهو جون سورل (John Searle)، الأمريكي الشهير الذي يشتغل في مجالي فلسفة اللغة وفلسفة العقل، والذي يعدّ من أهمّ المعارضين لتوجّه الذكاء الاصطناعي القويّ. أما من ناحية قانون مور فإنه ليس أبدياً بل لا بد وأن يصل إلى مرحلةٍ يتوقف فيها، لأنه لا يمكن أن يستمر تصغير الترانزستورات بشكل لانهائي، ناهيك عن المشاكل الكثيرة التي ستعترض الآلات في المجال الصغروي.

يشير غاناسيا في كتابه هذا إلى ملاحظةٍ مهمة وهي أن أولئك الذين يحذّرون من مخاطر الذكاء الاصطناعي هم نفسهم من يعمل على تطويره. ويسمّيهم بــ "رجال الإطفاء مفتعلي الحرائق" (Les pompiers-pyromanes)! وغالبا ما تكون دوافع هؤلاء سياسية. لهذا يؤكّد لوك جوليا في كتابه الذي ذكرناه أعلاه على ضرورة تحصيل معرفة جيدة بمنطق اشتغال الذكاء الاصطناعي، وامتلاك حسّ نقدي تجاه تلك الأفكار التي يقول بها إلون ماسك مثلاً. وإذا لم نقم بهذا فإننا سنترك المجال شاسعاً لأولئك الذين يريدون السيطرة على التكنولوجيا وحدهم. وكما يُظهر تاريخ الإنسانية فإن كل من اكتشف صناعةً ما وجلبت له الكثير من الأموال فإنه يميل عادةً إلى الإبقاء عليها لمصالحه الشخصية وحده. إضافة إلى أنّه يقترح، في هذا الصدد، استبدال مصطلح "الذكاء الاصطناعي" بمصطلح "الذكاء المتطور" (L’intelligencee augmentée) كمحاولةٍ لتجنّب كل تلك المخاوف والتضليلات التي يحملها المصطلح الأول من جهة، ومن جهة أخرى فإن المصطلح الثاني يجعلنا نفهم بشكل أوضح دور ذلك الذكاء الاصطناعي، أي باعتباره مجرد عامل يؤدي إلى تطوير الذكاء الإنساني وليس إلى خلعه عن عرشه والحلول مكانه.

بيد أن الأمر الذي لا شك فيه هو أنه بإمكان الإنسان أن يبرمج الآلات على فعل أي شيء مهما بلغت خطورة هذا الشيء، لهذا فليس الخطر في أنّ الآلات يمكن أن تفكّر بنفسها وتحوز على الوعي والشعور حتى بل أنها ستخضع لتفكير الإنسان وشعوره! فمثلما يمكن صنع سيارات ذاتية القيادة تضمن سلامة الناس بشكل كبير، يمكن أيضا صنع أسلحة ذاتية التشغيل وبرمجتها لقتل أي شخص. أي أن البعد السلبي حاضرٌ دائما في تطور الذكاء الاصطناعي، إذ لا يمكنه، بحجمه وقدراته الكبيرة، أن يلج حياة البشر دون لعنة. في هذا الصدد تتوضح ضرورة حضور ذلك البعد الأخلاقي في هذا المجال، خاصة عند المتخصصين في علم الكمبيوتر. وحتى إذا لم تكن الآلات قادرة وحدها على تدمير البشر، فإن البشر سيدمرون أنفسهم بأنفسهم باستعمال الآلات، هكذا يتبين أن مصير الإنسان، في كل الحالات، يتوقّف عليه ذاته. ونعود لما قاله فردريك سكينر (Frederic Skinner)، أستاذ علم النفس بجامعة هارفرد: ’’ ليست المشكلة أن تُفكّر الآلات بل المشكلة ألاّ يُفكّر الإنسان‘‘.

مصادر ومراجع المقالة:

- الباهي، حسان، الذكاء الصناعي وتحديات مجتمع المعرفة، أفريقيا الشرق،

- Jean-Gabriel Ganascia, le mythe de la singularité, éditions de Seuil, 2017.

- Luc Julia, l’intelligence artificielle n’existe pas, Editions First, 2019.

- Yuval Noah Harari, Homo Deus, A brief History of Tomorrow, Vintage, 2017.

- Verner Vinge, The coming technological singularity. In: https://mediacentrum.groenlinks.nl/sites/default/files/ the_coming_technological_singularity.pdf

- https://www.youtube.com/watch?v=8BXfd0dHh1o

- https://www.youtube.com/watch?v=2C1Y2bD5ZSE

- https://www.youtube.com/watch?v=d4rBh6DBHyw

- https://www.youtube.com/watch?v=4ChHc5jhZxs

- https://www.youtube.com/watch?v=n0BIcv1Nwc0

- https://www.youtube.com/watch?v=fFLVyWBDTfo

- https://www.youtube.com/watch?v=UAMsNykDqJY